Cargando...

Digital Skills

DataOps: la disciplina que separa a las empresas que usan datos de las que creen usarlos

6 min lectura

En resumen

La mayoría de las empresas mexicanas tienen datos. Pocas tienen una operación de datos funcional. DataOps es la metodología que cierra esa brecha, y entenderla ya no es opcional.

<h2>Tener datos no te hace data-driven</h2>

<p>Hay una ilusión común en las empresas mexicanas. Compran herramientas de analytics. Contratan un par de analistas. Construyen dashboards con gráficas de colores. Y asumen que ya son una empresa 'data-driven'. No lo son.</p>

<p>Ser data-driven no es tener datos. Es tener una operación que convierte datos crudos en decisiones de negocio de forma continua, confiable y rápida. La distancia entre ambas cosas es enorme, y la disciplina que la cierra tiene nombre: DataOps.</p>

<p>DataOps no es un software. No es un servicio que compras. Es una metodología que cambia la forma en que los datos fluyen dentro de una organización, desde su origen hasta la decisión que informan. Y si tu empresa no la está aplicando, probablemente está tomando decisiones con datos incompletos, desactualizados o directamente erróneos.</p>

<h2>De dónde viene y qué resuelve</h2>

<p>DataOps nació de una observación simple. El mundo del desarrollo de software tenía DevOps: una metodología que integra desarrollo y operaciones para entregar software más rápido y con menos errores. Los equipos de datos enfrentaban el mismo problema pero nadie les había dado las mismas herramientas metodológicas.</p>

<p>El resultado era predecible. Los equipos de data science construían modelos brillantes que tardaban meses en llegar a producción. Los ingenieros de datos mantenían pipelines frágiles que se rompían cada semana. Los analistas de negocio pedían reportes que llegaban tarde y con datos que ya no reflejaban la realidad. Todos trabajaban con datos, pero cada uno en su silo, con sus herramientas y sus procesos desconectados.</p>

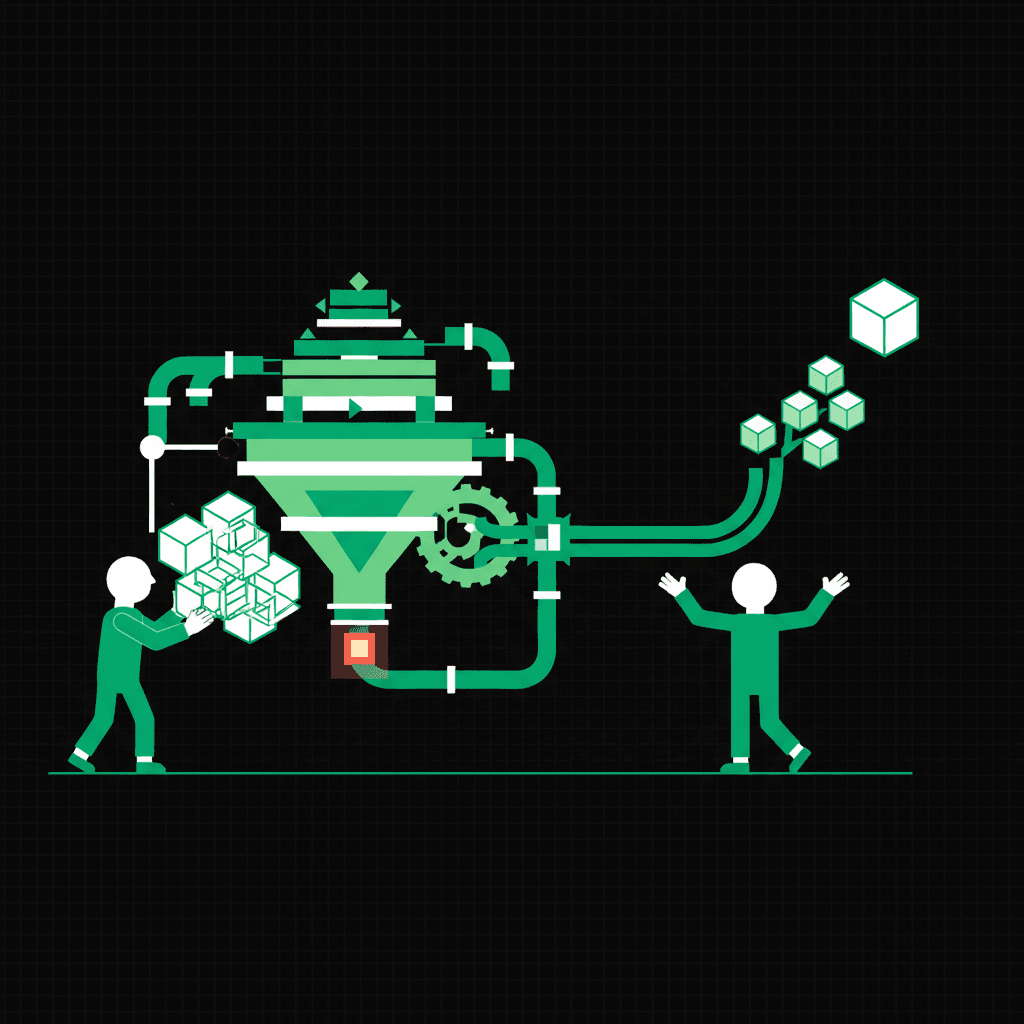

<p>DataOps resuelve esto tratando el flujo de datos como una línea de producción industrial. Los datos crudos entran por un lado, pasan por procesos de limpieza, transformación y validación, y salen por el otro lado convertidos en información lista para decidir. Cada paso está automatizado, monitoreado y probado. Cuando algo falla, se detecta automáticamente. Cuando algo cambia en la fuente, el pipeline se adapta.</p>

<h2>Por qué importa ahora en México</h2>

<p>México está en un punto de inflexión interesante. Las empresas grandes ya tienen datos. FEMSA, Banorte, Bimbo, Arca Continental: todas acumulan volúmenes masivos de información transaccional, operativa y de comportamiento de cliente. Las startups como Kavak, Clip y Konfío nacieron digitales y generan datos desde el día uno.</p>

<p>El problema no es la cantidad de datos. Es la calidad de la operación que los procesa. Y ahí México tiene un déficit serio.</p>

<p>Según estimaciones del sector, menos del 15% de las empresas mexicanas tienen un pipeline de datos automatizado de principio a fin. El resto depende de procesos manuales, extracciones en Excel, consultas ad hoc y analistas que pasan más tiempo limpiando datos que analizándolos. Es como tener una fábrica donde los operarios mueven materiales a mano mientras la competencia usa bandas transportadoras robotizadas.</p>

<p>La inteligencia artificial agrava la urgencia. Los modelos de machine learning necesitan datos limpios, actualizados y accesibles para funcionar. Sin DataOps, implementar IA es como poner un motor de Fórmula 1 en un coche sin llantas. Puedes tener el mejor modelo del mundo, pero si los datos que lo alimentan llegan tarde, sucios o incompletos, los resultados serán basura. Garbage in, garbage out, como dice el axioma.</p>

<h2>Los tres pilares que funcionan</h2>

<p>DataOps se sostiene sobre tres principios que cualquier empresa puede implementar, independientemente de su tamaño.</p>

<p>El primero es la automatización del pipeline. Cada paso del flujo de datos, desde la extracción hasta la entrega, debe estar automatizado. No porque la automatización sea más barata (que lo es), sino porque elimina el error humano. Un analista que copia datos manualmente de un sistema a otro va a cometer errores. No es cuestión de si, sino de cuándo. Un pipeline automatizado con validaciones integradas detecta anomalías antes de que contaminen las decisiones.</p>

<p>El segundo es la cultura de pruebas continuas. En desarrollo de software, nadie despliega código sin tests. En datos, la mayoría de las empresas despliegan reportes y modelos sin probar que los datos subyacentes son correctos. DataOps introduce tests automatizados sobre los datos: validaciones de esquema, rangos esperados, completitud, consistencia temporal. Cuando un dato sale del rango normal, salta una alerta antes de que alguien tome una decisión basada en información corrupta.</p>

<p>El tercero es la colaboración estructurada. DataOps rompe los silos entre ingenieros de datos, científicos de datos, analistas de negocio y tomadores de decisión. No con reuniones ni con 'alineación de equipos'. Con infraestructura compartida, procesos comunes y visibilidad total del estado de los datos. Cuando el CFO pide un número, debe poder rastrear de dónde viene, cómo se calculó y cuándo se actualizó por última vez. Si no puede, el número no es confiable.</p>

<h2>Lo que sale mal sin DataOps</h2>

<p>Las consecuencias de no tener una operación de datos profesional no son abstractas. Son medibles.</p>

<p>Un ecommerce mexicano que toma decisiones de inventario con datos de ventas que se actualizan cada 24 horas pierde ventas cada día por faltantes que no detectó a tiempo. Un banco que alimenta sus modelos de riesgo crediticio con datos inconsistentes aprueba créditos que no debería y rechaza clientes que debería aceptar. Una empresa de consumo masivo que no puede cruzar datos de sell-in con sell-out en tiempo real está volando a ciegas sobre su cadena de distribución.</p>

<p>Gartner estima que la mala calidad de datos cuesta a las organizaciones un promedio de 12.9 millones de dólares anuales. No en empresas pequeñas. En empresas que ya invierten en datos pero no tienen la operación para gestionarlos correctamente.</p>

<p>En México, donde muchas empresas están en las primeras etapas de su madurez analítica, el costo se manifiesta de forma diferente: en oportunidades perdidas que nadie cuantifica porque nadie tiene los datos para cuantificarlas. Es el costo invisible de la ignorancia operativa.</p>

<h2>No necesitas un ejército. Necesitas disciplina.</h2>

<p>El error más común al escuchar sobre DataOps es pensar que requiere un equipo enorme y un presupuesto millonario. No es así. Las herramientas se democratizaron. dbt, Airflow, Great Expectations, Prefect: son herramientas de código abierto que permiten a un equipo pequeño construir pipelines de datos profesionales.</p>

<p>Lo que sí requiere es disciplina. Disciplina para documentar cada transformación de datos. Disciplina para escribir tests antes de desplegar un pipeline. Disciplina para no tomar atajos cuando 'urge' un reporte y la tentación es extraer datos manualmente 'solo está vez'. Porque 'solo está vez' se repite cada semana hasta que se convierte en el proceso normal.</p>

<p>Las empresas mexicanas que inviertan en DataOps antes que sus competidores van a tomar mejores decisiones, más rápido. No porque tengan más datos, sino porque confían en los datos que tienen. Y en un mercado donde la velocidad de decisión es ventaja competitiva, esa confianza vale más que cualquier dashboard bonito.</p>

<p>Los datos sin operación son ruido. La operación sin datos es intuición. DataOps es lo que convierte el ruido en señal y la intuición en estrategia.</p>

Escrito por

Equipo Editorial ISDI México

ISDI México

El equipo editorial de ISDI México analiza las tendencias que están redefiniendo los negocios digitales en Latinoamérica, con foco en inteligencia artificial, growth y transformación digital.

‹ TAMBIÉN TE PUEDE INTERESAR ›

‹ PROGRAMAS RELACIONADOS ›

Lleva este conocimiento al siguiente nivel

Programas diseñados para profesionales que quieren pasar de leer sobre el tema a dominarlo.

Ejecutivo

Inteligencia Artificial para Ejecutivos

Aprende a liderar proyectos de aprendizaje automático y sistemas inteligentes con enfoque estratégico y de negocio.

9 semanas · 84 horasOnline

Conocer programa

MasterMaster in Internet Business

Es el primer máster integral de transformación, profesionalización, y especialización del negocio digital.

9 meses · 450 horasPresencial viernes y sábados

Conocer programa

BootcampTaller de IA Aplicada a Negocios

El Taller de Inteligencia Artificial aplicada a negocios es el programa intensivo que te enseña a aplicar la inteligencia artificial en tu negocio, sin necesidad de saber programar.

5 semanas · 40 horasOnline en vivo

Conocer programa

Para empresas

¿Tu equipo necesita estas competencias?

Diseñamos programas a la medida de tu organización. Desde talleres de IA de 8 horas hasta transformaciones de 6 meses con certificación.

Programas desde 8 horasCertificación ISDI